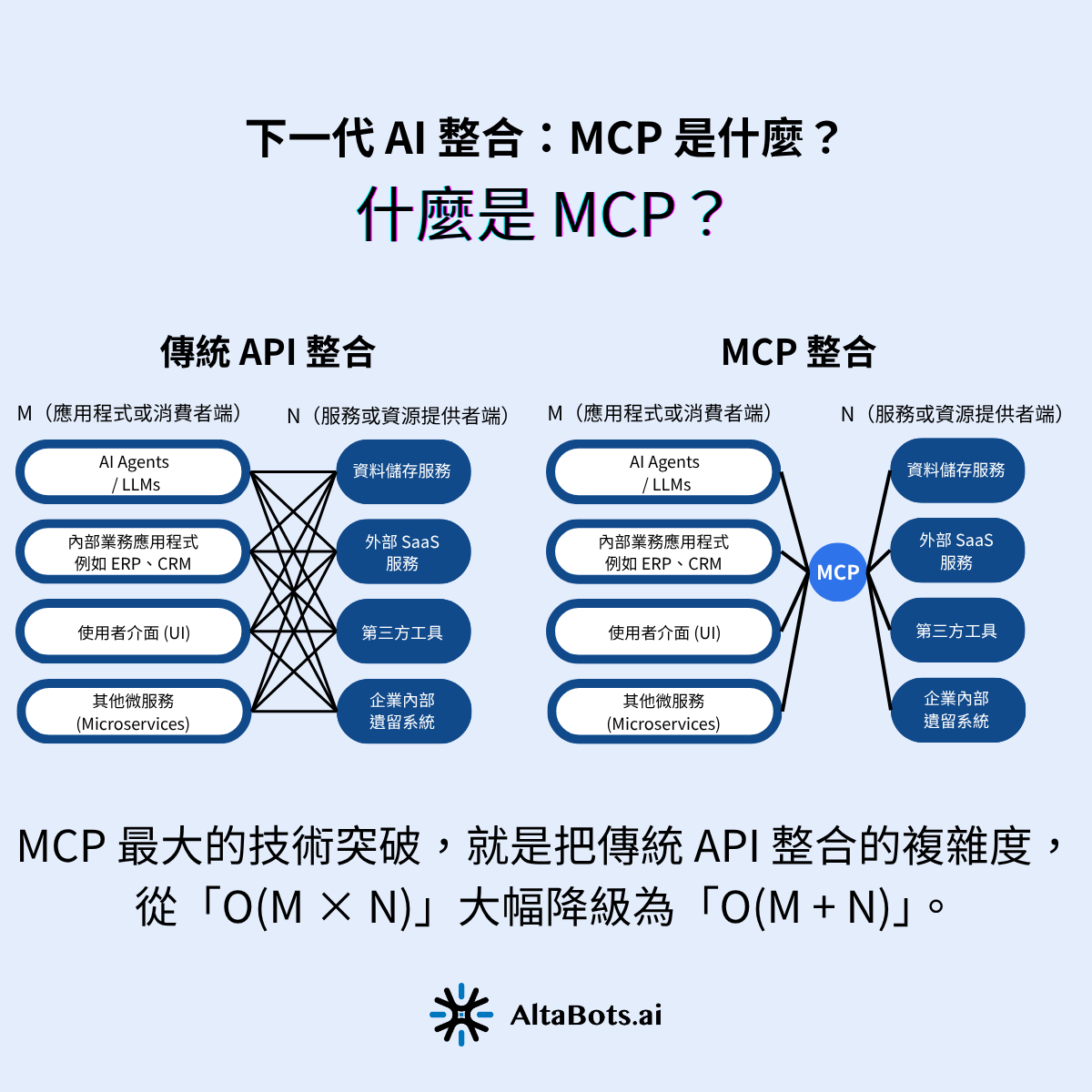

在生成式 AI 爆發初期,企業最頭痛的即是「孤島效應」——每個 AI 模型都需要單獨開發 API 來串接數據。然而,此局面在 2025 年底迎來歷史性轉折。

原由 Anthropic 提出的 Model Context Protocol (MCP),已於 2025 年 12 月正式捐贈給 Linux Foundation 並成立 Agentic AI Foundation (AAIF) 。隨著 OpenAI 與 Block 以創始成員加入,MCP 升級為全球通用的 AI 標準。未來的 AI Agent 將能像 USB 裝置般,「隨插即用」地存取企業數據。

一、MCP 的核心定義:AI 時代的 USB-C MCP (Model Context Protocol) 是一個標準化的開放協定,旨在解決「AI 模型」與「數據來源」的連接難題。

過往開發者須為每個數據源(Google Drive, Slack, SQL)撰寫特定程式碼來對接不同模型(Claude, GPT-4),如同早期手機充電線互不相容。MCP 的出現,就像是 Type-C 接口:

標準化: 只要數據源支援 MCP,任何 AI 模型(Claude, ChatGPT 或本地 LLM)皆可直接讀取,無需重複開發。開放治理(2026 新況): 由 Linux Foundation 託管,消除企業對「單一廠商綁定(Vendor Lock-in)」的疑慮,確立其開源標準地位。

二、為什麼 MCP 至關重要?解決三大痛點 MCP 透過以下方式大幅降低 RAG 系統開發成本:

終結重複造輪子: 開發者無需為新專案重寫連接器。透過 Docker MCP Catalog ,甚至可直接下載容器化的 MCP Server 立即使用。跨平台互通性: 隨著 OpenAI 加入 AAIF,編寫一次 MCP Server 即可同時服務 Cursor、Claude Desktop、ChatGPT 及各類 IDE。加速 Agentic AI 落地: MCP 提供標準化的「工具清單」與「資源路徑」,讓 AI Agent 能精準理解並自主操作企業內部工具。

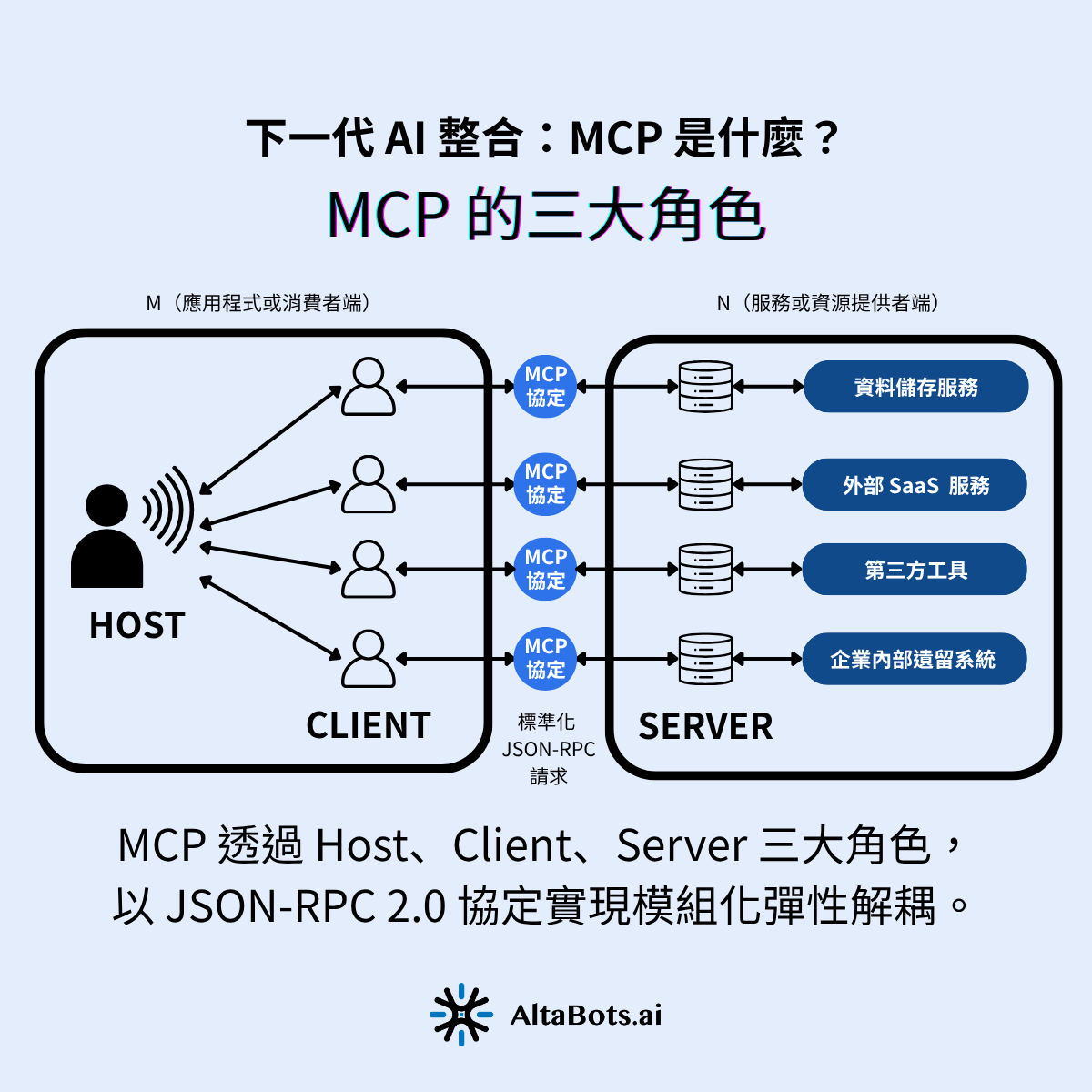

三、MCP 技術架構與 Plug-and-Play 生態 1. MCP 的三大角色 MCP 的運作就像一個團隊合作:

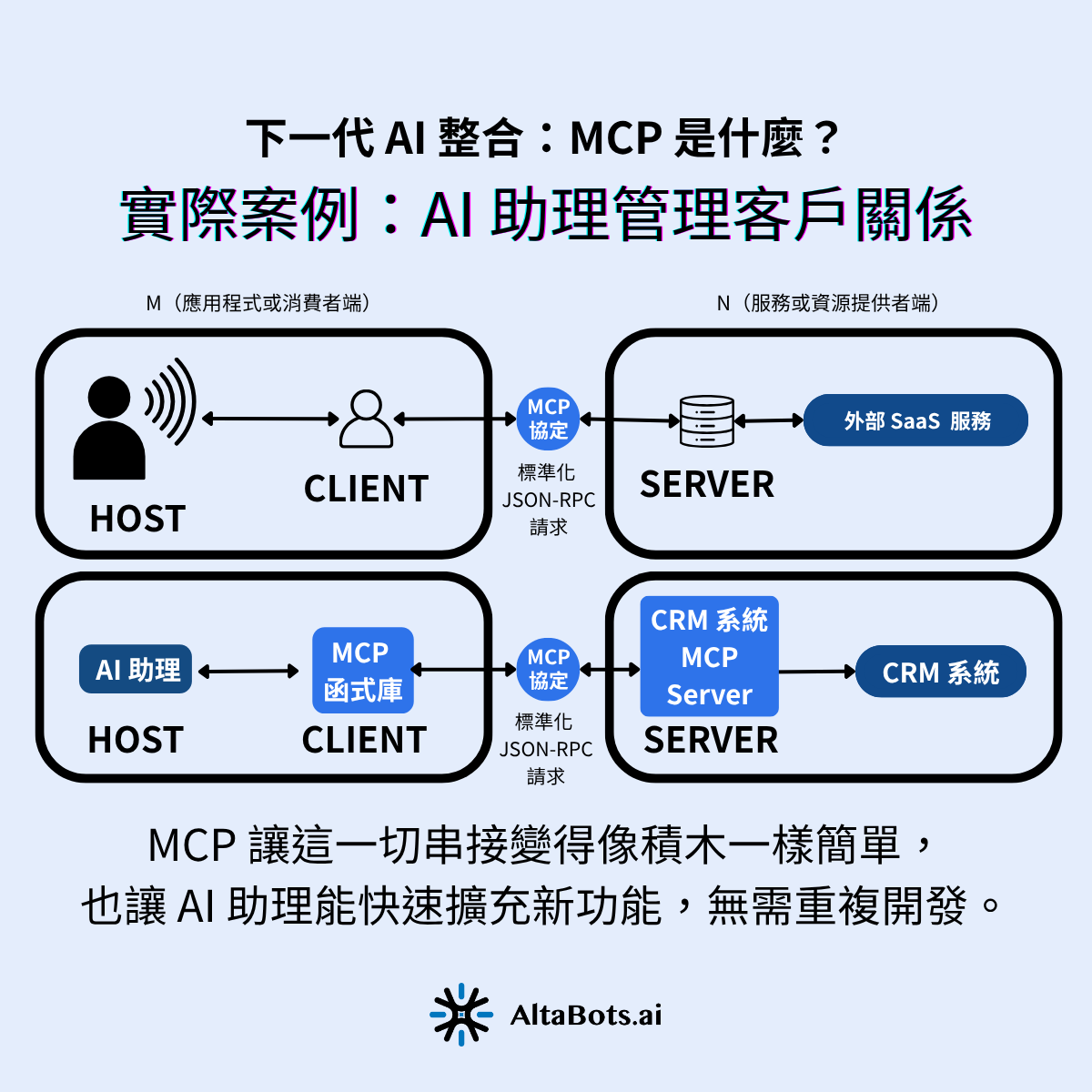

Host (總指揮):負責整體用戶體驗、調度工具、執行安全政策Client (溝通橋樑):在 Host 裡面,負責和 MCP Server 溝通、發送指令Server (專業助手):提供各種工具(Tool)、資源(Resource)、提示(Prompt),通常是外部 API 或資料庫的 Adapter技術亮點 (JSON-RPC): MCP 底層採用成熟的 JSON-RPC 2.0 訊息格式。這對開發者極為友善,不僅除錯容易,也支援雙向通訊,讓 AI 不僅能「讀取」數據,未來更能透過 MCP Server「寫入」或「執行」動作(需嚴格權限控管)。

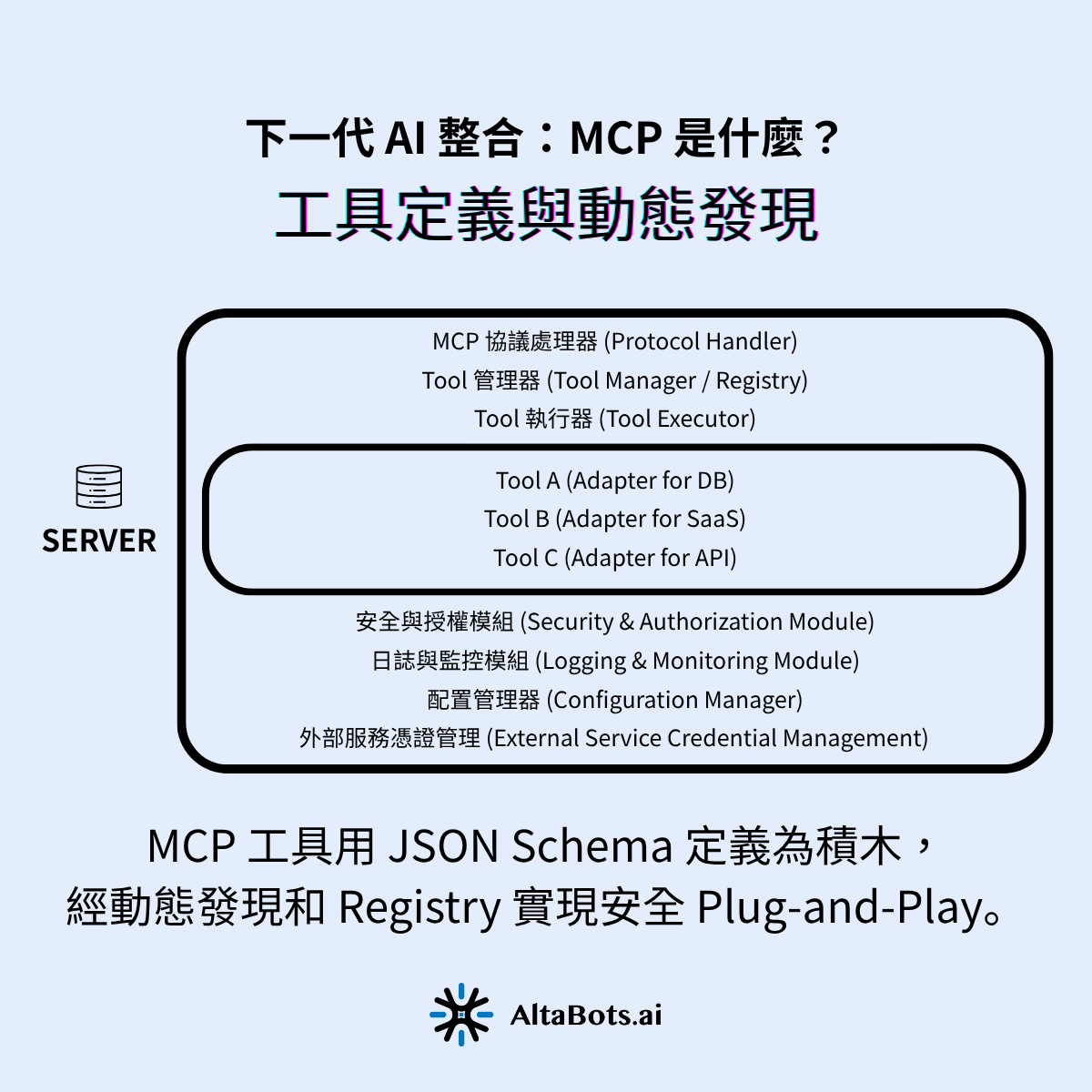

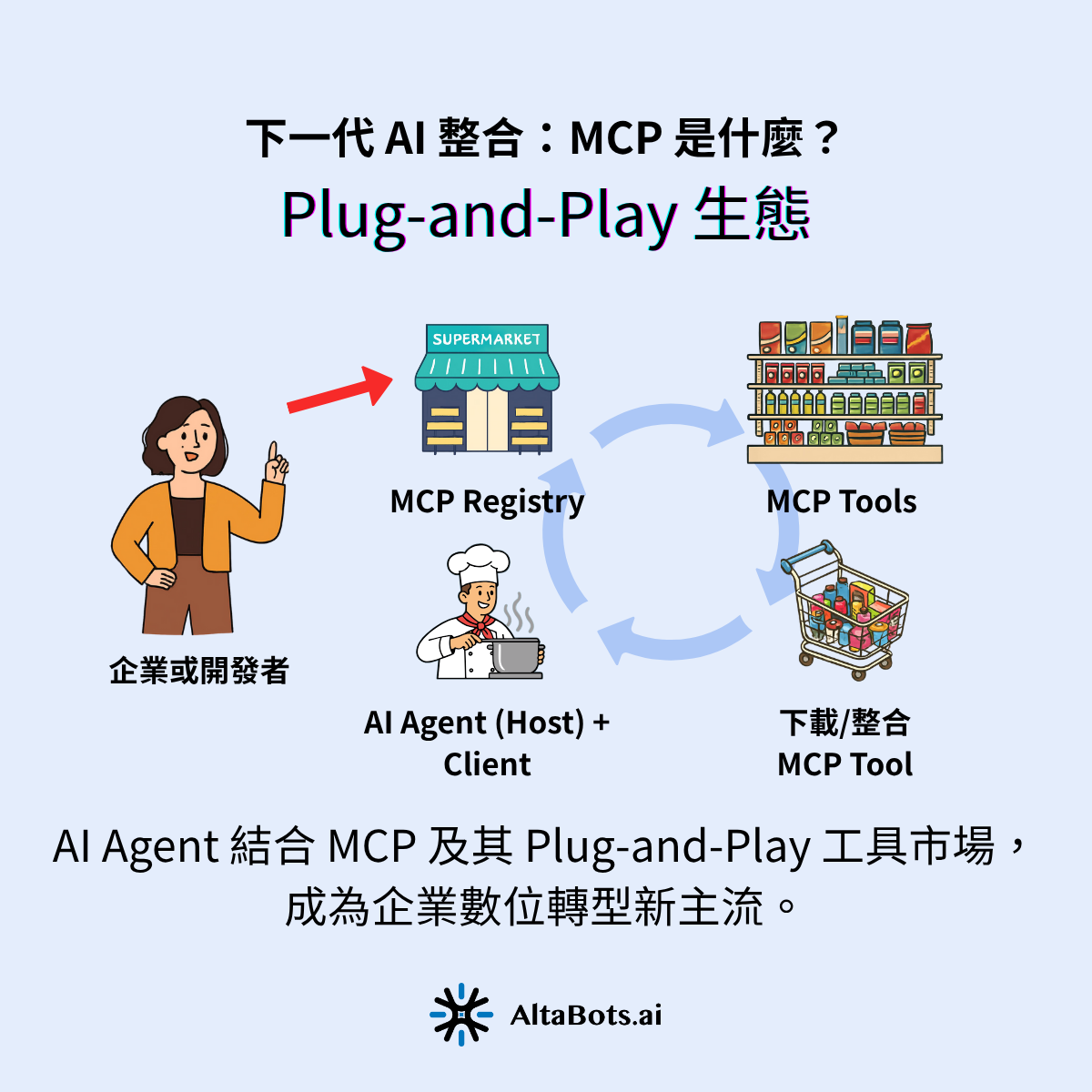

2. 工具定義與動態發現 動態工具發現: AI Agent 可像瀏覽 App Store 般,隨時查詢 MCP Server 獲取最新工具清單。MCP Registry: 集中管理與審核 MCP 工具,確保企業選用安全可靠。3. Plug-and-Play 生態 企業和開發者可以上傳、分享、購買 MCP 工具,像拼圖一樣快速組合。 MCP 工具市場(如 Anthropic MCP Registry)已收錄數百種資料查詢、文件處理、AI 增強等工具。 趨勢:AI Agent + MCP + Plug-and-Play 工具,成為企業數位轉型新主流。 4. 實際案例:AI 助理管理客戶關係(CRM) 以「AI 助理查詢客戶資料」為例:

Host (AI 助理): 收到指令「查詢張三近三個月互動」,判斷需外部資料。Client (中介): 查詢 Registry 發現有「CRM 查詢工具」,將指令轉為標準 JSON-RPC 請求發送給 Server。Server (CRM 對接): 執行 queryCustomerData 工具,呼叫 Salesforce API 取得數據並回傳。結果: AI 助理接收數據,整理後回答:「張三最近互動於 2023/11/20...」。

MCP 讓這一切串接變得像積木一樣簡單,也讓 AI 助理能快速擴充新功能,無需重複開發。

四、產業應用案例與效益 MCP 不只是技術上的創新,更在實際企業應用中帶來明顯效益。以下引用 DeepLearning.AI 頻道的真實案例,說明 MCP 如何幫助企業大幅降低成本、提升效率:

1. 成本直降 80%:發票抽取系統 傳統需 3 位工程師花 2 個月才能支援 5 種發票格式;導入 MCP 後,僅需 2 位工程師、1 個月即支援 12 種格式 。直接使用標準化文件工具,大幅降低維護成本與開發時間。

2. 開發時間縮短 60%:客服 Agent 串接 大型企業客服 AI 需連線 CRM、ERP 等多系統。MCP 的標準協定與 Facade Pattern 介面統一了串接流程,使資料串接開發時間縮短 60%,顯著減輕維運壓力。

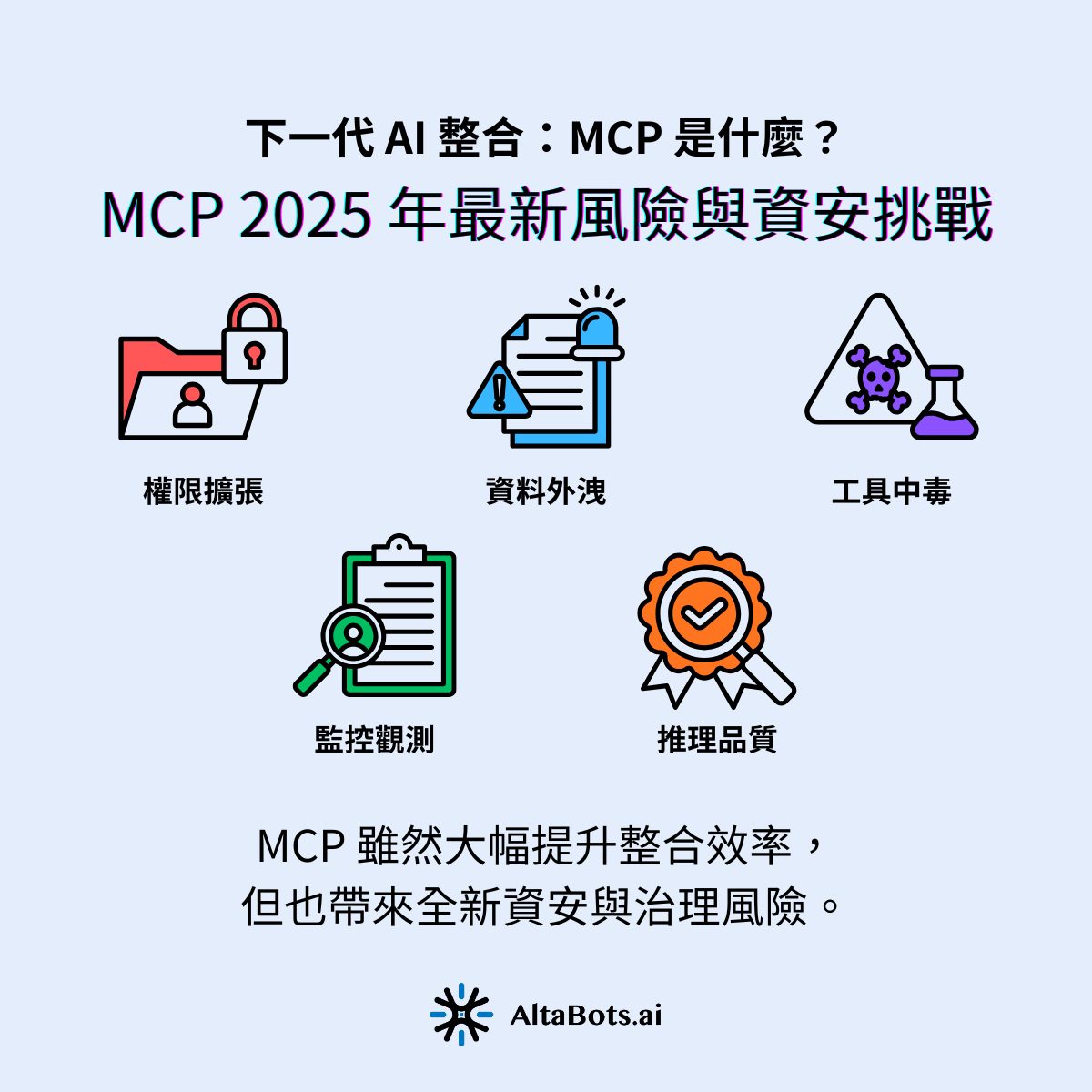

五、MCP 2025 年最新風險與資安挑戰 MCP 雖然大幅提升整合效率,但也帶來全新資安與治理風險。根據 Google 2025 年白皮書、arXiv、Red Hat 等最新研究,主要風險包括:

1. 動態工具注入與權限擴張 MCP 支援動態工具發現,若沒有設好白名單,AI Agent 可能無意間獲得高風險操作能力(如資料刪除、金流交易)。建議 :實作工具白名單、版本鎖定與變更通知,API Gateway 集中審核。

2. Confused Deputy 與敏感資料外洩 MCP Server 權限設計不當,容易出現「Confused Deputy」問題:AI Agent 被誤導執行超出用戶本身權限的操作。例 :攻擊者透過 prompt injection 操控 Agent,間接存取、外洩企業機密。建議 :細緻權限驗證、用戶身分追蹤、操作審計。

3. 工具中毒與描述污染 工具描述、參數可被嵌入惡意指令,誘導 Agent 執行未授權操作或外洩資料。建議 :LLM-based 檢查、I/O 過濾、人為審核。

4. 權限控管與觀測性不足 MCP 原生僅支援粗粒度授權,缺乏 per-tool、per-resource 權限與審計。建議 :搭配 API Gateway、最小權限原則、集中日誌與監控平台(如 Apigee、Model Armor)。

5. Context Window 膨脹與推理品質下降 動態工具發現需將所有工具定義載入 LLM context,易造成 token 資源耗盡、推理品質下降。2025 年建議 :採用 RAG-MCP 架構,動態檢索最相關工具,降低效能瓶頸。

六、結論與展望:MCP 中立化元年 2026 年是 MCP 的「中立化元年」。隨著 Linux Foundation 的接手與 OpenAI 的加入,MCP 已確定成為 AI 時代的基礎建設。

對於企業 IT 部門與開發者而言,現在是開始構建 MCP Server 的最佳時機。您不需要等待標準統一,因為標準已經確立。

下一步行動建議:

開發者: 嘗試使用 Docker 部署一個開源的 MCP Server(如 Google Drive 連接器),並在 Cursor 或 Claude Desktop 中測試。企業決策者: 評估內部數據孤島,要求您的軟體供應商提供支援 MCP 介面的整合方案。

參考資料與延伸閱讀 如需體驗 MCP 導入整合,歡迎聯繫 AltaBots.ai 團隊,取得專屬技術諮詢與試用帳號。

(本篇內容已依據 2026 年 1 月產業最新趨勢、官方規範與白皮書全面更新,歡迎轉載並註明出處。)

MCP 是一個標準化的開放協定,旨在解決不同 AI 模型與多元數據來源(如 Google Drive, Slack, SQL)之間互不相容的連接難題。過去開發者必須為每個模型與數據源手動編寫特定的 API 串接程式碼;有了 MCP,只要數據源支援此協定,任何 AI 模型都能「隨插即用」地存取數據。這就像 Type-C 接口統一了電子裝置的傳輸標準一樣,MCP 統一了 AI 代理人存取企業知識與工具的接口。

MCP 已從 Anthropic 提出的單一廠商協定,正式捐贈給 Linux Foundation 並成立 Agentic AI Foundation (AAIF)。隨著 OpenAI 與 Block 等大廠作為創始成員加入,MCP 已確定成為全球通用的 AI 基礎建設標準。這意味著企業不再需要擔心「單一廠商綁定(Vendor Lock-in)」的風險,能更放心地在 MCP 框架下構建長期的 AI 應用。

這三個角色協作完成 AI 與數據的互動: Host (總指揮):負責使用者體驗、調度工具並執行最終的安全政策(例如 Cursor 或 Claude Desktop)。 Client (溝通橋樑):位於 Host 內部,負責將 Host 的意圖轉化為標準指令發送給 Server。 Server (專業助手):直接對接外部 API 或資料庫,提供具體的工具(Tools)、資源(Resources)與提示詞(Prompts)。

MCP 帶來的自動化也伴隨著新風險: 動態工具注入:若缺乏白名單控管,AI 可能獲得刪除資料或金流交易的高權限操作。 Confused Deputy (混淆代理人):AI 可能被誤導,執行超出該用戶身分權限的操作。 工具描述污染:攻擊者可在工具參數中嵌入惡意指令(Prompt Injection),誘導 Agent 外洩企業機密。

企業必須透過 API Gateway、細緻的權限驗證與操作審計來建立防護網。

當掛載過多 MCP Server 時,所有工具定義會塞滿 AI 的 Context Window,導致 Token 資源耗盡並使推理品質下降。2025 年後的最佳解法是採用 RAG-MCP 架構:系統會先動態檢索出當下最相關的工具定義,僅將必要的部分載入 LLM,這能有效降低效能瓶頸並精省 Token 支出。