2026 年初, AI 領域正式從「對話機器人」跨入「自主代理人( AI Agent )」的實戰階段。根據我們輔導台灣各大企業數位轉型的經驗,這場轉變對企業主管而言,意義已不僅限於追蹤技術趨勢,它直接關乎人力配置、流程重組,乃至整體機密防護的生死交關。

Anthropic 於 2025 年底將 Agent Skills 框架升格為開放標準,而開源社群也順勢推出了強大的自託管( Self-Hosted )工具 OpenClaw 。然而,對多數台灣企業而言,真正的考驗不在於導入哪一項最新技術,而在於:如何在不失控、不洩密的環境下,將這股浪潮轉化為受控的組織生產力?

目前市場上的 AI 代理人發展,已明顯分化為「官方標準化框架」與「開源自託管框架」兩條路線。了解兩者的本質差異,是企業決策者避開資安地雷的第一步。

Claude Skills 是一套模組化的功能擴充包,能讓 Anthropic 的 Claude AI 動態載入( Dynamic Loading )特定指令、腳本與資源,藉此執行高度專業化的任務 [3] 。

與依賴雲端基礎架構的 Claude 不同, OpenClaw 是一個開源的自主 AI 代理框架,主打「自託管」與「系統級存取( System-level access )」 [2] 。

技術前景誘人,但在實際落地時,企業主管必須正視以下三道高牆:

儘管框架逐漸開放,撰寫完整的 Claude Skill 仍需理解 YAML 語法、除錯( Debugging )邏輯與 API 協議;而部署 OpenClaw 更需要熟悉本地環境配置。企業內部往往面臨「 IT 部門建好工具,但非技術部門(行政、業務、財務)不會用也用不到」的窘境。

這是目前企業面臨最大的隱患。根據資安機構 Check Point Research 在 2026 年 2 月底發布的最新漏洞通報, AI 代理人若缺乏納管,將成為駭客攻擊的跳板(如 CVE-2025-59536 與 CVE-2026-21852 )。

這揭示了一個殘酷的事實:當員工為了貪圖方便,私下用個人帳號串接 API 或在公司電腦部署 OpenClaw (即影子 AI ),公司不僅難以控管資料流向,更可能在毫不知情下成為供應鏈攻擊的破口。

國際原生 AI 工具多以英文與歐美軟體生態為主。台灣企業高度依賴的 LINE 生態圈、繁體中文語境,以及本地法規要求(如個資法與 ISO 27001 ),在導入初期往往需要額外的客製化開發與適配成本。

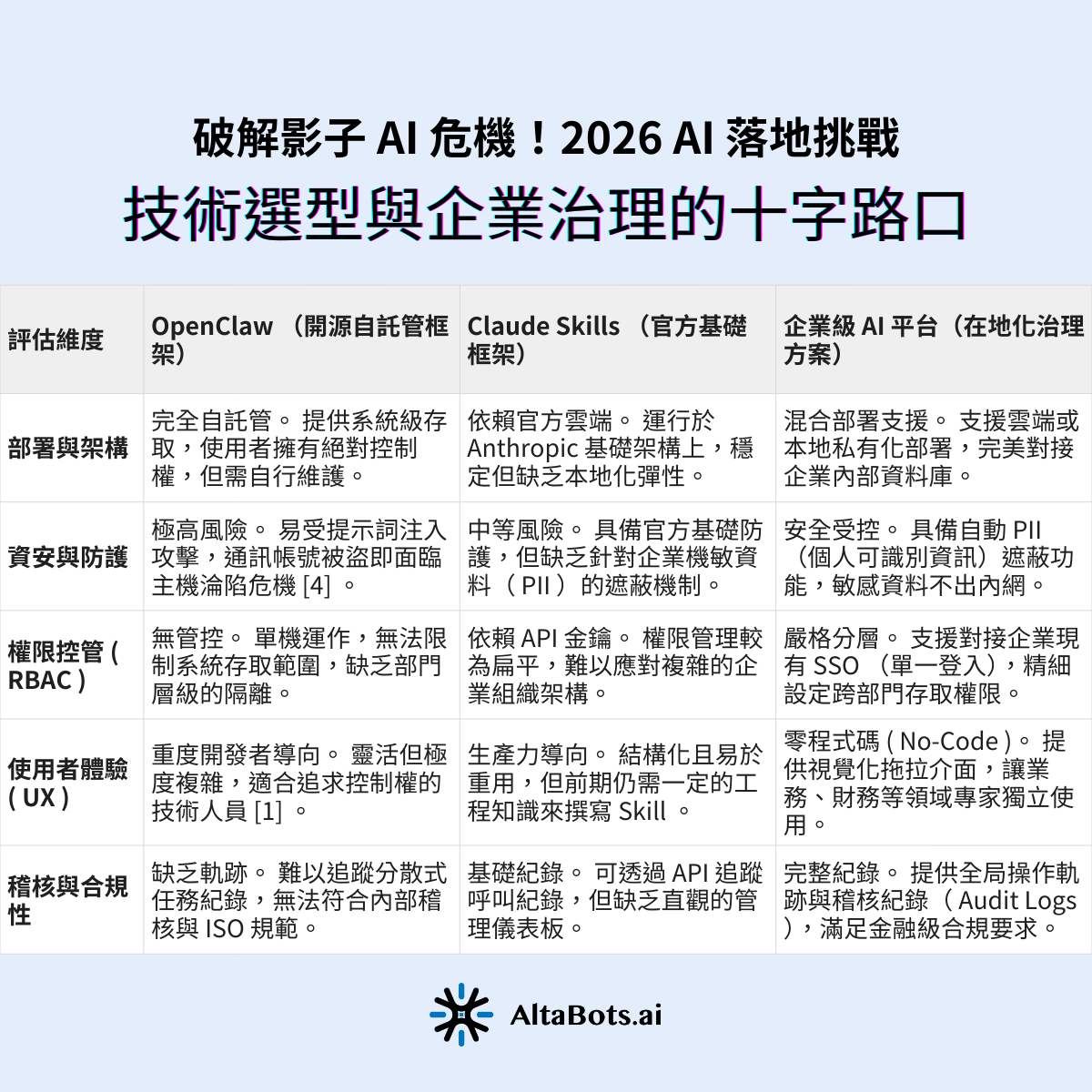

為了讓企業主管更直觀地評估導入風險,我們將「 Claude Skills 」、「 OpenClaw (影子 AI 風險)」與「企業級 AI 管理平台(以 AltaBots.ai 等為例)」進行了五大維度的對比:

從上表可以看出,依賴員工個人的技術能力來使用 OpenClaw 或原始 API ,不僅無法規模化,更會讓企業暴露在難以預測的資安風險中。建立具備完整治理架構的「企業級中介平台」,已是不可迴避的基礎建設。

為確保企業安全邁入 AI 代理人時代,建議主管於本季優先執行以下三步驟:

技術決定了能力的上限,但管理機制決定了企業生存的下限。

正視資安風險並導入完善的治理框架,才是讓 AI 成為最佳數位員工的最務實路徑。如果想知道 AltaBots.ai 如何協助企業安全導入 AI,歡迎填寫表單,我們的專業顧問將會與您分享成功案例。

[1] DataCamp. ( 2026 ). OpenClaw vs Claude Code: Architecture, Security, and Market Impact. 點擊閱讀

[2] DigitalOcean. ( 2026 ). What is OpenClaw: An Open-Source Autonomous AI Agent. 點擊閱讀

[3] Anthropic. ( 2026 ). Agent Skills Overview & Documentation. 點擊閱讀

[4] LinkedIn / Brandon Galang. ( 2026 ). Security Implications of OpenClaw and Self-Hosted AI Agents. 點擊閱讀

[5] Check Point Research. ( 2026 ). Caught in the Hook: RCE and API Token Exfiltration Through Claude Code Project Files. 點擊閱讀完整資安報告